Apple setzt auf direkte Manipulation

Apple Vision Pro: So funktionieren Tastatur und die sechs Handgesten

Apple ist in der WWDC Video-Session #10073 („Design for spatial input“) genauer auf die Eingabeoptionen eingegangen, die Nutzern der Virtual-Reality-Brille Apple Vision Pro zur Verfügung stehen werden.

Apple setzt auf direkte Manipulation

Unter anderem werden diese eine vollwertige Bildschirm-Tastatur mit beiden Händen nutzen können und sollen sich auch in anderen Bereichen des neuen Betriebssystems auf den so genannten „direct touch“ verlassen können, also auf die direkte Manipulation von Bildschirminhalten mit den Fingern.

Auf Webseiten etwa soll sich mit einer herkömmlichen Wischgeste nach oben oder unten scrollen lassen, Links, Tasten und Regler können intuitiv berührt, aktiviert und bewegt werden.

Um Tastatureingaben so natürlich wir möglich wirken zu lassen, nutzt Apple nicht nur akustisches Feedback, sondern animiert die Tasten auch mit einem leichten Glanz, sobald die eigenen Finger über den entsprechenden Tasten schweben.

Dreidimensionale Effekte sorgen dann dafür, dass Anwender den Tastendruck zumindest optisch nachvollziehen können. Apple verspricht, dass Nutzer eine Responsivität wie von einer regulären Hardware-Tastatur erwarten sollen.

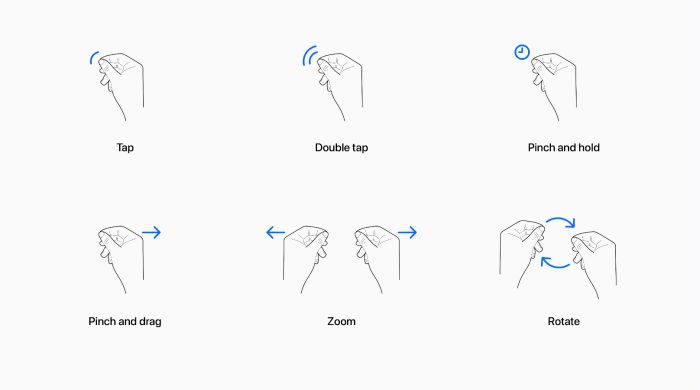

Sechs Handgesten verfügbar

Was die Manipulation von Objekten im Sichtfeld der Mixed-Reality-Brille angeht, bietet Apple den Nutzern der Apple Vision Pro sechs unterschiedliche Handgesten an: Den Tap, den Doppel-Tap, Greifen und Halten, Greifen und Ziehen, Zoomen und Rotieren.

Die Gesten selbst lassen sich dabei überall im Sichtfeld der Apple Vision Pro ausführen, auch mit ganz entspannten Händen, die etwa im Schoß abgelegt wurde. Sobald die Kameras der Apple Vision Pro die Hände erfassen, was außer hinter dem Rücken nahezu überall der Fall ist, werden Eingabegesten wie Scrollbefehle auch entsprechend ausgewertet, ohne das die virtuelle Webseite dafür im Raum „berührt“ werden muss.

„Dreidimensionale Effekte sorgen dann dafür, dass Anwender den Tastendruck zumindest optisch nachvollziehen können.“

Wie hätte die Oberfläche wohl unter Scott Forstall ausgesehen? Stichwort: Skeuomorphismus

Da wäre die Tastatur dann eine Schreibmaschine gewesen :D

Das war nicht Scott, sondern der Jony Ive. Scott hat das maps Debakel gemacht

Ich meine er hat recht, Scott war auch dafür verantwortlich. Die Maps Geschichte und seine Entlassung ist im Nachhinein ja eh lächerlich.

https://www.iphone-ticker.de/scott-forstall-ehemaliger-ios-chef-erzaehlt-von-steve-jobs-und-einem-toten-fisch-157803/

Trigger für mich :-P

Ich mochte die Liebe zum Design bis iOS 6 sehr. Stichwort: Kompass ! Für mich eine Legende, wie gut der aussah.

Da aber im Moment alle Hersteller auf FLAT-Design setzen mache ich mir wenig Hoffnung, jemals wieder in den Genuß von fotorealistischen UIs zu kommen. Obwohl die hochauflösenden Displays GENAU DAS hervorragend möglich gemacht hätten. Ein Trauerspiel.

+1

+1 Aber wetten wir, dass es irgendwann wieder kommt und alle es toll finden?

Ich bevorzuge da lieber eine echte physische Tastatur beim arbeiten. Soll ja auch funktionieren. Aber klar. Wenn man gerade keine zur Hand hat. Freue mich schon darauf.

Beeindruckend sowas. Könnte ich mir sie leisten, würde ich sie sofort kaufen.

Abwarten :D

Wirst sehen, das wird laufen;) haben ja noch 10 Monate Zeit :)

Richtig interessant wird es, wenn die Technik soweit fortgeschritten ist, das dies alles in ein normales Brillengehäuse passt

RICHTIG interessant wird es wenn es als Kontaktlinse verfügbar ist. ODER: einfach implantiert wird… zusammen mit dem GPS-Chip und Tracking…

Eine Handsimulation schreibt ein „Hello, malt ein Herz und n Sonne in naiver Grafik. Wahnsinn!

Also so stelle ich mein Homeoffice 2.0 NICHT vor.

Ich denke das sollte nur die Genauigkeit demonstrieren.

Oder eher die gewünschte. Wenn man sich die Anfänge beim iPad anschaut und wo wir heute sind, wird da weiterhin mehr unleserliches bei raus kommen :D

Sehr cool, dass man anscheinend in Freeform Schreiben kann. Im Slack Chat meinten die Apple Entwickler aber, dass man da erstmal selbst was bauen muss. Vielleicht kommt es dann später für alle Entwickler:innen.